OpenAI از GPT-5، یک مدل هوش مصنوعی پرچمدار جدید که نسل بعدی ChatGPT این شرکت را قدرت خواهد بخشید، رونمایی کرد.

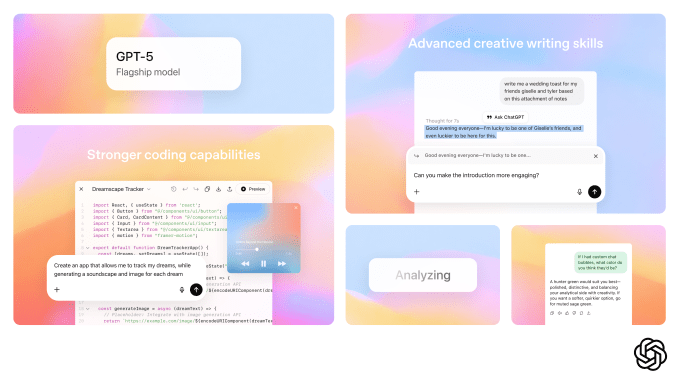

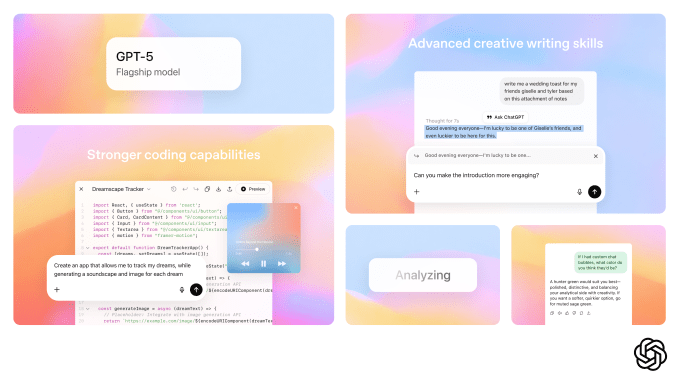

گزارش اختصاصی رسا نشر – GPT-5 که روز پنجشنبه منتشر شد، اولین مدل هوش مصنوعی “یکپارچه” OpenAI است و تواناییهای استدلال مدلهای سری O خود را با پاسخهای سریع سری GPT خود ترکیب میکند. این مدل نسل بعدی، دوران جدیدی را برای ChatGPT – و خالق آن، OpenAI – نشان میدهد که به جاهطلبیهای گستردهتر OpenAI برای توسعه سیستمهای هوش مصنوعی که بیشتر شبیه عاملها هستند تا رباتهای چت اشاره دارد.

در حالی که GPT-4 رباتهای چت هوش مصنوعی را قادر ساخت تا پاسخهای هوشمندی را به طیف گستردهای از سوالات ارائه دهند، GPT-5 به ChatGPT اجازه میدهد تا طیف گستردهای از وظایف را از طرف کاربران انجام دهد – مانند تولید برنامههای نرمافزاری، پیمایش تقویم کاربر یا ایجاد خلاصههای تحقیقاتی.

با GPT-5، OpenAI همچنین تلاش کرده است تا استفاده از ChatGPT را سادهتر کند. به جای اینکه از کاربران خواسته شود تنظیمات مناسب را انتخاب کنند، GPT-5 به یک روتر بلادرنگ مجهز شده است که تصمیم میگیرد چگونه بهترین پاسخ را ارائه دهد، چه این پاسخ سریع به سوالات کاربر باشد و چه صرف زمان بیشتر برای “فکر کردن” در مورد پاسخها.

اعتبار تصویر: OpenAI

سم آلتمن، مدیرعامل OpenAI، در جریان یک جلسه توجیهی با خبرنگاران، ادعا کرد که GPT-5 “بهترین مدل در جهان” است و گفت که این نشان دهنده “گامی مهم” در مسیر شرکت برای توسعه هوش مصنوعی است که میتواند در ارزشمندترین کار اقتصادی – یعنی هوش عمومی مصنوعی (AGI) – از انسانها پیشی بگیرد.

آلتمن گفت: “داشتن چیزی مانند GPT-5 در هیچ زمان دیگری در تاریخ تقریباً غیرقابل تصور خواهد بود.”

از روز پنجشنبه، GPT-5 به عنوان مدل پیشفرض برای همه کاربران رایگان ChatGPT در دسترس خواهد بود. نیک تورلی، معاون ChatGPT در OpenAI، گفت که این بخشی از تلاش شرکت برای دسترسی رایگان کاربران به یک مدل استدلال هوش مصنوعی برای اولین بار است. (پیش از این، این شرکت این مدلهای پیشرفتهتر را پشت یک دیوار پرداخت قرار میداد.)

تورلی در مورد این تصمیم گفت: «این تنها یکی از راههایی است که من برای انجام این ماموریت هیجانزدهام، مطمئن شدن از اینکه این چیزها واقعاً به نفع مردم است.» این گفتهی تورلی با اشاره به ماموریت دیرینهی OpenAI برای توزیع هوش مصنوعی پیشرفته به بیشترین تعداد ممکن از مردم است.

انتظارات از GPT-5، یکی از مورد انتظارترین محصولات OpenAI از زمان معرفی این شرکت توسط ChatGPT در سال 2022، بسیار زیاد است. از آن زمان، ChatGPT به یکی از محبوبترین محصولات مصرفی جهان تبدیل شده است و هر هفته بیش از 700 میلیون کاربر دارد – طبق گفتهی این شرکت، تقریباً 10٪ از جمعیت جهان.

بسیاری GPT-5 را به عنوان یک پیشگام برای پیشرفت هوش مصنوعی به طور گسترده میدانند و استقبال از این مدل توسط سیلیکون ولی میتواند پیامدهای عمیقی برای شرکتهای بزرگ فناوری، وال استریت و سیاستگذاران تنظیمکنندهی فناوری داشته باشد. این ذینفعان در حال بررسی این موضوع هستند که آیا GPT-5 جهش قابل توجهی در قابلیتهای هوش مصنوعی ارائه میدهد یا خیر، دقیقاً مانند مدل قبلی خود، GPT-4 که انتظارات از قابلیتهای نرمافزار را به چالش کشید.

GPT-5 کمی در رقابت برتری دارد.

OpenAI ادعا میکند که GPT-5 در چندین حوزه پیشرفته است و در معیارهای کلیدی، مدلهای هوش مصنوعی پیشرو از Anthropic، Google DeepMind و xAI ایلان ماسک را کمی کنار میزند. با این حال، GPT-5 در سایر زمینهها کمی از مدلهای هوش مصنوعی پیشرو ضعیفتر عمل میکند.

این شرکت میگوید GPT-5 عملکرد سطح بالایی را در زمینه کدنویسی ارائه میدهد. آلتمن گفت که این مدل به طور خاص در زمینه کدنویسی کل برنامههای نرمافزاری بر اساس تقاضا، در چیزی که به عنوان “کدنویسی vibe” شناخته میشود، عالی عمل میکند.

در SWE-bench Verified – آزمایشی از وظایف کدنویسی در دنیای واقعی که از GitHub گرفته شده است – GPT-5 در اولین تلاش خود 74.9٪ امتیاز کسب میکند. این یعنی GPT-5 از آخرین مدل Claude Opus 4.1 شرکت Anthropic که امتیاز 74.5% را کسب کرد و Gemini 2.5 Pro شرکت Google DeepMind که امتیاز 59.6% را کسب کرد، عملکرد بهتری دارد.

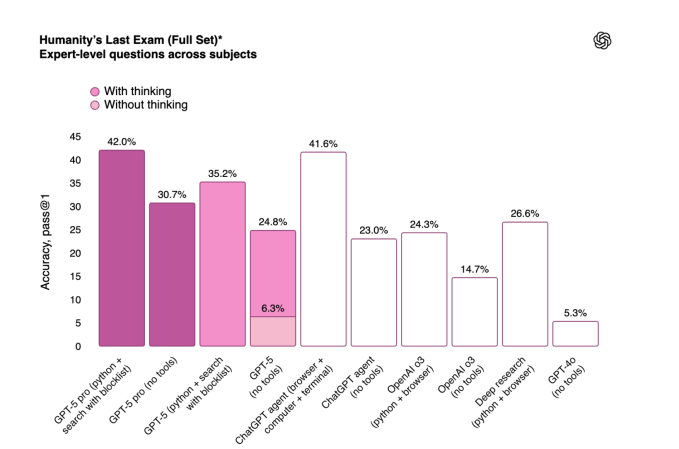

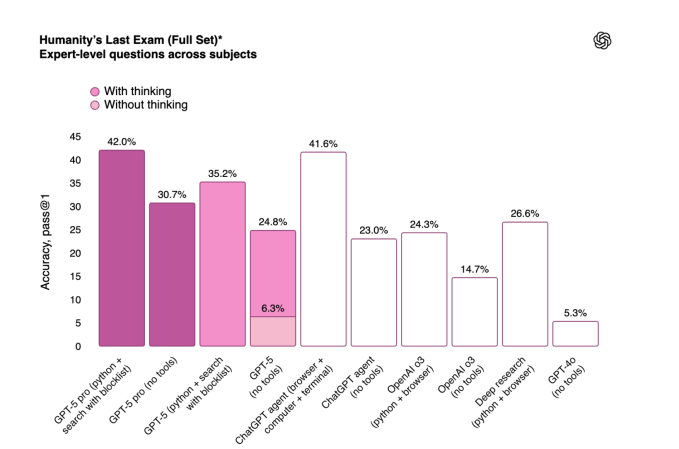

در Humanity’s Last Exam – آزمونی دشوار برای سنجش عملکرد مدل هوش مصنوعی در ریاضیات، علوم انسانی و علوم طبیعی – نسخهای از GPT-5 با استدلال گسترده (GPT-5 Pro) هنگام استفاده از ابزارها، امتیاز 42% را کسب کرد. این مقدار کمی کمتر از امتیازی است که xAI با Grok 4 Heavy که امتیاز 44.4% را در این آزمون کسب کرد، به دست آورد.

اعتبار تصویر: OpenAI

در GPQA Diamond – آزمونی برای سوالات علوم سطح دکترا – GPT-5 pro در اولین تلاش خود امتیاز 89.4% را کسب کرد و از Claude Opus 4.1 که امتیاز 80.9% را کسب کرد و Grok 4 Heavy که امتیاز 88.9% را کسب کرد، عملکرد بهتری داشت.

OpenAI میگوید GPT-5 برای پاسخ به سوالات مربوط به سلامت بهتر است. در آزمایشی که دقت پاسخهای مدل هوش مصنوعی پیرامون موضوعات مراقبتهای بهداشتی، HealthBench Hard Hallucinations، را اندازهگیری میکند، OpenAI میگوید GPT-5 (با تفکر) تنها ۱.۶٪ مواقع دچار توهم میشود. این میزان بسیار کمتر از مدلهای قبلی GPT-4o و o3 این شرکت است که به ترتیب ۱۲.۹٪ و ۱۵.۸ امتیاز کسب کردند.

در حالی که چتباتهای هوش مصنوعی متخصص پزشکی نیستند، میلیونها نفر از آنها برای مشاوره سلامت استفاده میکنند. در پاسخ به این پدیده، این شرکت میگوید GPT-5 در مورد علامتگذاری نگرانیهای بالقوه سلامت و کمک به کاربران در تجزیه و تحلیل نتایج پزشکی، پیشگیرانهتر عمل میکند.

علاوه بر این، OpenAI میگوید GPT-5 در حوزههای ذهنی و اندازهگیری دشوارتر، مانند طراحی خلاقانه و نوشتن، بهتر از سایر مدلهای هوش مصنوعی عمل میکند. تورلی گفت GPT-5 طبیعیتر پاسخ میدهد و در انجام وظایف خلاقانه، “سلیقه بهتری” نسبت به سایر مدلهای هوش مصنوعی نشان میدهد.

GPT-5 همچنین از مدلهای قبلی OpenAI دقیقتر است و این شرکت میگوید که در مقایسه با مدلهای سری o خود، از توهم – تمایل مدلهای هوش مصنوعی به ساخت اطلاعات – بسیار کمتر رنج میبرد. به نظر میرسید توهم در جدیدترین مدلهای استدلال هوش مصنوعی OpenAI، مانند o3، بدتر شده است و OpenAI پیش از این گفته بود که کاملاً نمیفهمد چرا این اتفاق میافتد.

در پاسخ به سوالات ChatGPT، OpenAI دریافت که GPT-5 (با تفکر) در ۴.۸٪ مواقع دچار توهم میشود و با اطلاعات نادرست پاسخ میدهد. این کاهش قابل توجهی نسبت به o3 و GPT-4o است که به ترتیب ۲۲٪ و ۲۰.۶٪ در آزمون، میزان توهم را نشان میدهند.

در معیاری که توانایی عامل یک مدل هوش مصنوعی را برای انجام وظایف آنلاین شبیهسازی شده اندازهگیری میکند، Tau-bench، GPT-5 عملکرد متفاوتی ارائه میدهد. در بخشی از آزمون که توانایی هوش مصنوعی را برای پیمایش وبسایت یک شرکت هواپیمایی اندازهگیری میکند، GPT-5 امتیاز ۶۳.۵٪، کمی پایینتر از o3 که امتیاز ۶۴.۸٪ را کسب کرد. در بخش دیگری از آزمون که توانایی هوش مصنوعی در پیمایش وبسایتهای خردهفروشی را اندازهگیری میکرد، GPT-5 امتیاز ۸۱.۱٪ را کسب کرد که از Claude Opus 4.1 که امتیاز ۸۲.۴٪ را کسب کرده بود، عملکرد ضعیفتری داشت.

OpenAI همچنین میگوید که GPT-5 از مدلهای قبلی خود ایمنتر است. در حالی که مدلهای استدلال هوش مصنوعی گاهی اوقات تمایل به توطئه علیه انسانها یا دروغ گفتن برای پیشبرد اهداف خود نشان میدهند، OpenAI دریافت که GPT-5 با نرخ پایینتری نسبت به سایر مدلها فریبنده است.

الکس بیوتل، سرپرست تحقیقات ایمنی OpenAI، گفت که کاهش فریب نه تنها ایمنی GPT-5، بلکه تجربه کاربر را نیز بهبود میبخشد و مدلی ایجاد میکند که “شفافتر و صادقانهتر است، به گونهای که کاربران بتوانند به آن اعتماد کنند.”

بیوتل همچنین خاطرنشان میکند که GPT-5 در تشخیص بین بازیگران بدی که سعی در سوءاستفاده از ChatGPT دارند و کاربرانی که درخواستهای بیضرر میکنند، بهتر عمل میکند. این امر منجر به این میشود که GPT-5 بتواند سوالات ناامن بیشتری را رد کند، در حالی که رد کمتری به کاربرانی که به دنبال اطلاعات بیضرر هستند، ارائه میدهد.

ارتقاء برای مصرفکنندگان و توسعهدهندگان

ChatGPT به عنوان بخشی از راهاندازی GPT-5، چند ارتقاء تجربه کاربری دریافت میکند. کاربران اکنون میتوانند از بین چهار شخصیت جدید در تنظیمات ChatGPT انتخاب کنند: Cynic، Robot، Listener و Nerd. این شرکت میگوید که این موارد، پاسخهای ChatGPT را بدون نیاز به درخواست خاص کاربران از مدل برای پاسخ به روشی خاص، تطبیق میدهند.

مشترکین طرح Plus با هزینه 20 دلار در ماه ChatGPT، محدودیتهای استفاده بالاتری برای GPT-5 نسبت به کاربران رایگان دریافت میکنند. در همین حال، مشترکین Pro با هزینه 200 دلار در ماه، به GPT-5 دسترسی نامحدود خواهند داشت، و همچنین یک نسخه ارتقا یافته به نام GPT-5 Pro که از منابع محاسباتی اضافی برای تولید پاسخهای بهتر استفاده میکند. سازمانهایی که در طرحهای Team، Edu و Enterprise OpenAI هستند، به موارد زیر دسترسی خواهند داشت: GPT-5 هفته آینده به عنوان مدل پیشفرض آنها ارائه خواهد شد.

برای توسعهدهندگان، GPT-5 در سه اندازه – gpt-5، gpt-5-mini و gpt-5-nano – به API OpenAI میآید که زمان بیشتری یا کمتری را صرف “استدلال” از طریق وظایف میکنند. توسعهدهندگان اکنون میتوانند میزان پرگویی را در API OpenAI کنترل کنند و تصمیم بگیرند که پاسخهای یک مدل هوش مصنوعی چقدر طولانی یا کوتاه باشد.

مدل پایه GPT-5 برای توسعهدهندگان 1.25 دلار به ازای هر میلیون توکن ورودی (تقریباً 750،000 کلمه، طولانیتر از کل مجموعه “ارباب حلقهها”) و 10 دلار به ازای هر میلیون توکن خروجی هزینه خواهد داشت.

راهاندازی GPT-5 پس از یک هفته شلوغ برای OpenAI انجام میشود. این شرکت یک مدل استدلال وزن باز، gpt-oss، را منتشر کرد که توسعهدهندگان و شرکتها میتوانند آن را به صورت رایگان دانلود کرده و با کسری از هزینه اجرا کنند. این مدل باز تقریباً با تواناییهای مدلهای برتر قبلی OpenAI، o3 و o4-mini، مطابقت داشت، اما GPT-5 استاندارد جدیدی را برای عملکرد پیشرو در برخی زمینهها، مانند کدنویسی.

با این حال، به نظر میرسد GPT-5 در چندین زمینه تقریباً با سایر مدلهای هوش مصنوعی پیشرو برابری میکند. البته، معیارها تنها بخشی از داستان را برای هر مدل هوش مصنوعی بیان میکنند و باید دید که توسعهدهندگان چگونه از GPT-5 در دنیای واقعی استفاده خواهند کرد و آیا این مدل واقعاً یک قدم بالاتر از رقبا است یا خیر.